Column

「社員の8割が会社に内緒でAIを使用」シャドーAIの最新実態と中小企業がいま打つべき手

「うちの社員も、会社に内緒でAIを使っているかもしれない」——2026年の最新調査では、8割のオフィスワーカーが公共のAIを業務に使い、6割の企業が情報漏洩を経験しています。本記事では、シャドーAIの最新実態を数字で押さえ、中小企業がいま打つべき次の一手を解説します。

この記事でわかること

- 2026年最新調査が示す、シャドーAIの"想像以上"の広がり

- なぜ「禁止令」だけではシャドーAIは止まらないのか

- いますぐ着手できる、中小企業向けの3つの対策

目次

- シャドーAIとは何か(30秒で把握)

- 2026年の最新数字|実態は想像以上に広がっている

- なぜシャドーAIは生まれるのか

- 中小企業がいま打つべき3つの手

- AIサポーターズとしての見解

- まとめ

シャドーAIとは何か(30秒で把握)

シャドーAIとは、会社のIT部門の管理・承認なしに、社員が個人的に外部のAIツール(ChatGPT、Gemini、Claude など)を業務に使用している状態を指します。

語源は「シャドーIT」——社員が情シスの管理外でSaaSやクラウドサービスを勝手に使う、長年指摘されてきた課題——から派生したものです。生成AIの普及により、シャドーITの「AI版」がこの数年で急速に広がりました。

シャドーAIで起こりうる問題は、主に4つあります。

- 情報漏洩リスク:機密情報や顧客データを公共のAIに入力すると、外部に渡る可能性がある

- データの所有権の不透明化:入力した内容がAIベンダーの学習データに使われるリスク

- 法的・契約上の責任:顧客との秘密保持契約(NDA)違反、業界規制違反などの恐れ

- AI生成成果物の品質保証:誰がいつ何を作ったかが追えず、誤情報や著作権侵害の検出が難しい

注意したいのは、シャドーAIをやっている社員の多くは 悪意があるわけではない という事実です。むしろ「真面目に業務効率化を考えている人」ほどシャドーAIに手を出しやすい——それが実態です。

2026年の最新数字|実態は想像以上に広がっている

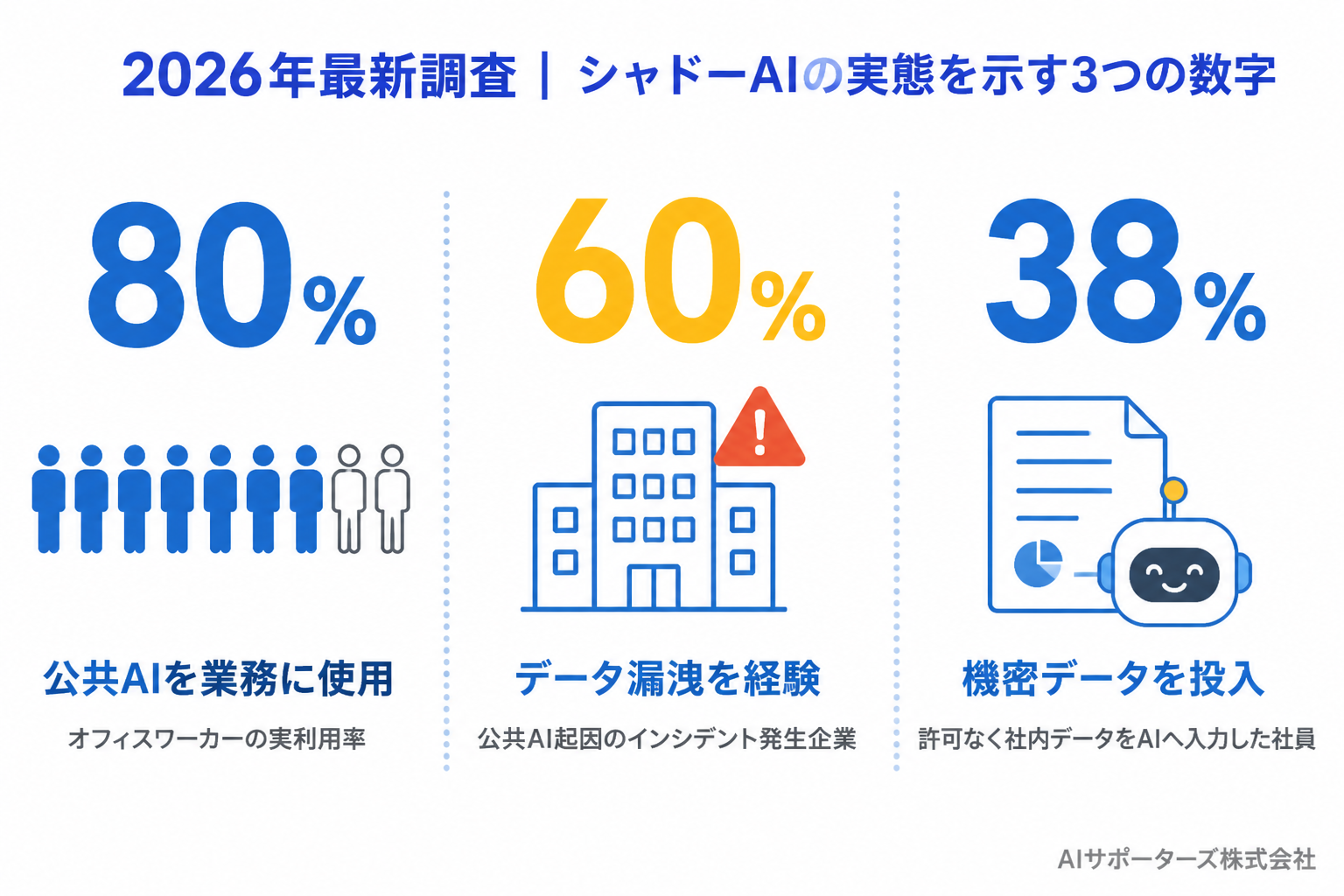

シャドーAIの広がりは、経営者の感覚を大きく超えています。2026年に発表された複数の調査結果を整理すると、現状はこうです。

- オフィスワーカーの 80% が公共AIを業務に利用している(Lenovo 6,000人調査)

- 会社支給ツールだけを使っている人は 22% のみ——残り 78% は何らかの個人利用が混ざる

- 3人に1人が情シスの監視外で AI を利用している

- 企業の 60% がシャドーAI起因のデータ漏洩を既に経験している

- 社員の 38% が機密データを許可なく AI に投入したことがある

- 一方で、AI利用規程を更新できているのは 15% のみ、正式なAIガバナンスを持つ企業は 36% にとどまる

- 結果として、54% の企業が AI 誤用起因の金銭損失を経験している

「ウチは大丈夫」と思っている経営者ほど、この認識ギャップが危険です。社員に正直に聞いてみると、想定の数倍の利用率が出てくることが珍しくありません。

なぜシャドーAIは生まれるのか

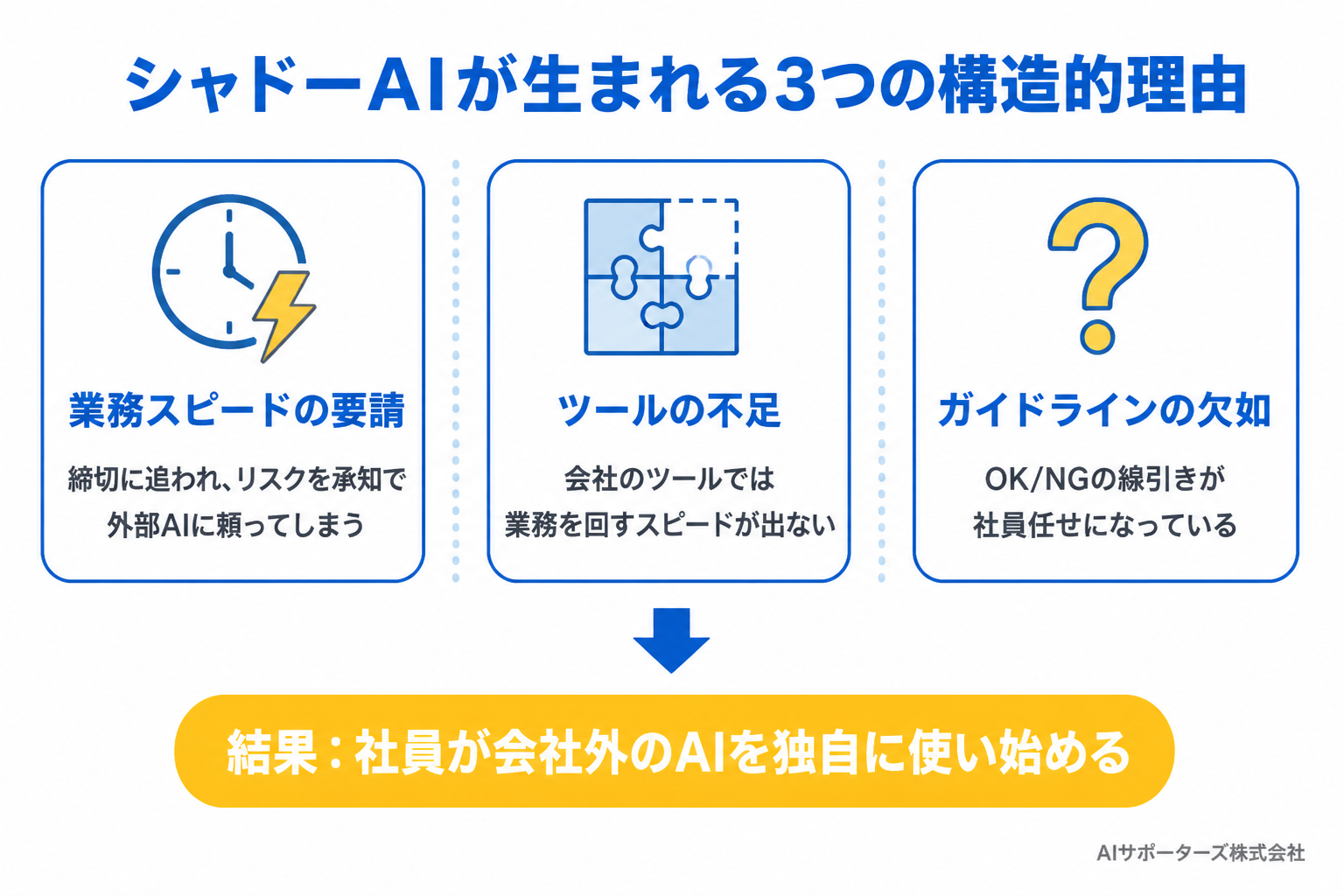

「会社が禁止しても、なぜ社員はAIを使うのか」——この問いに向き合わないと、対策は空回りします。シャドーAIが生まれる構造的な理由は、大きく3つです。

理由1:業務スピードへのプレッシャー

締切に追われる中で、社員は「2時間かかる資料作成を30分に短縮できるなら使う」という判断をします。リスクを承知のうえで、目の前の仕事を回すための合理的な選択として、シャドーAIに手が伸びます。

理由2:会社が用意したツールの不足/使いにくさ

「会社のツールではできないことが、ChatGPT では一発でできる」——この差が大きいほど、シャドーAIが発生します。会社が制限の強いツールしか提供せず、それを業務効率化と紐づけて運用していなければ、社員は外部に答えを求めます。

理由3:ガイドラインと教育の欠如

「何がOKで何がNGか分からない」状態だと、社員は 自己判断で線を引く しかありません。「これくらいなら大丈夫だろう」が積み重なり、結果的に重大な漏洩につながります。

経営側に多い盲点は、禁止令だけ出して、代替ツールも教育も提供していないこと。これでは、社員は「使うな」と言われて表面的にうなずきつつ、裏で使い続けます。

中小企業がいま打つべき3つの手

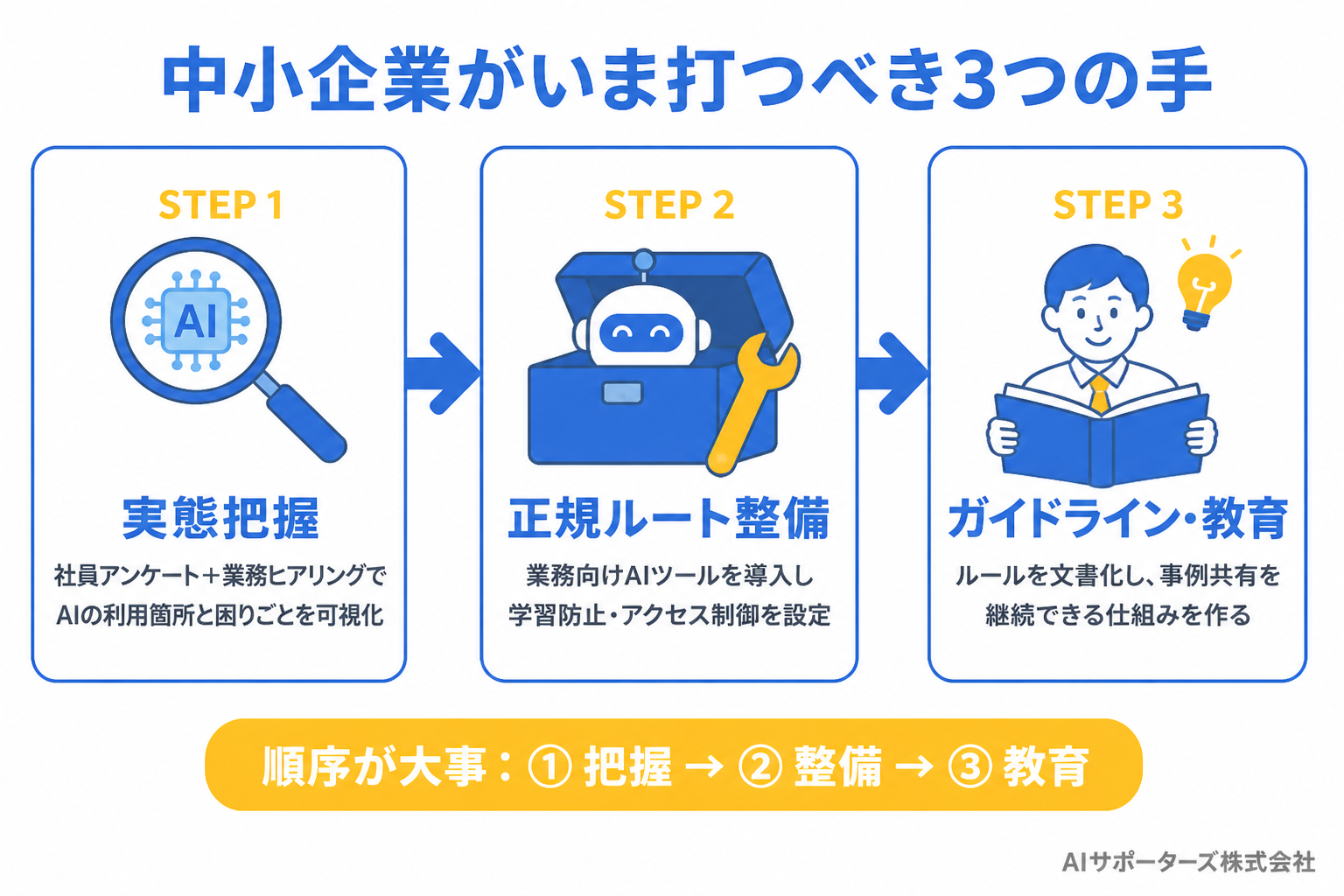

シャドーAIへの対策は、難しく考える必要はありません。順序を間違えずに 3 ステップで進めるのが現実的です。

対策1:実態把握

まずは「自社で実際にどこまでAIが使われているか」を可視化します。

- 社員アンケート(匿名)で「業務でAIを使っているか/どのツールか/どんな用途か」を聞く

- 業務ヒアリングで「どの作業で困っているか/どこで時短したいか」を集める

- これがそのまま 次のステップで導入すべきツールの優先順位 にもなる

対策2:正規ルートの整備

社員が安全に使える業務用AIツールを、会社として正式に用意します。

- 業務向け生成AI(API版 ChatGPT、Microsoft Copilot、Google Gemini for Workspace など)を導入

- データ保護・アクセス制御(学習に使わせない設定、ログ取得、入力制限)を設定

- 「これを使えば安全」というデフォルトの選択肢を社員に提供する

対策3:ガイドラインと教育

ルールと使い方をワンセットで整備します。

- 「機密情報の取扱い」「ハルシネーション(誤情報)対策」「成果物の検証手順」を文書化

- 一度の研修で終わらせず、定期的な事例共有で更新し続ける

- 「禁止」ではなく「こう使えば安全で、こう使うと業務が回る」という前向きなメッセージにする

順序が大事です。①実態把握 → ②ツール整備 → ③ガイドライン・教育。逆順でやろうとすると、現場の納得感が得られず形骸化します。

AIサポーターズとしての見解

AIサポーターズとしては、シャドーAIを 「社員のサボり」ではなく「会社側の対応の遅れ」が引き起こしている事象 だと考えています。

社員はリスクを知ったうえで、目の前の仕事を回すためにAIを使っています。これを「禁止」で抑え込もうとすると、見えないところに潜るだけで、リスクはむしろ高まります。

中小企業がやるべきは、ガチガチに禁止することではありません。「使えるツールと使い方を、会社として提供する」こと。それだけで、シャドーAIの大半は「ホワイトAI」に変わります。

「実態把握 → ツール整備 → 教育」の一連を、社内だけで進めるのが難しい場合は、外部の伴走を活用するのも現実的な選択肢です。禁止令ではなく、現場が使い続けられる仕組みを作ることが、結果的に最大のリスク低減になります。

まとめ

- シャドーAIは想像以上に広がっている(オフィスワーカーの 8 割)

- リスクは情報漏洩・コンプライアンス・金銭損失に直結し、すでに 60% の企業が漏洩を経験

- 禁止令だけでは止まらない——構造的な3つの理由がある

- 中小企業は ①実態把握 → ②正規ルート整備 → ③ガイドライン・教育 の順で進める

- 「禁止」ではなく「サポート」のスタンスが、結果的にリスクを下げ、生産性を上げる

AIサポーターズでは、中小企業の生成AI活用支援を、実態把握から社内ツール内製・教育まで一連で伴走しています。「シャドーAIの存在は気になるけど、何から手を付ければいいか分からない」という方は、お気軽にお問い合わせください。

参考

- Help Net Security: Shadow AI risks deepen as 31% of users get no employer training

- JumpCloud: 11 Stats About Shadow AI in 2026

- SQ Magazine: Shadow AI Usage Statistics 2026

- IBM: Is rising AI adoption creating shadow AI risks?